L'intelligenza artificiale applicata ai contenuti visivi interessa molti colossi tecnologici, e certamente anche Facebook. Mentre Microsoft la sta impiegando per migliorare Word e altri prodotti Office, e mentre Google da anni la integra nel suo motore di ricerca, ora il social network ha varato una nuova tecnologia: Lumos. Il sistema è in grado di riconoscere i contenuti di una fotografia cioè non solo la presenza di persone, oggetti e animali all'interno della scena, ma presto sarà in grado di fare anche altro, come per esempio riconoscere l'azione rappresentata.

Già sperimentata da Facebook come servizio per gli utenti con disabilità visive (in associazione a software di lettura con sintesi vocale), la tecnologia di Lumos troverà ora un impego più esteso. Come spiegato in un blogpost da Joaquin Quiñonero Candela, direttore della divisione Applied Machine Learning, l'ambizione è quella di permeare di intelligenza artificiale l'intero social network e consentire così una diversa “mappatura” e “comprensione” delle immagini. Per i contenuti visivi, il motore di ricerca interno non dovrà più limitarsi ai tag ma potrà sfruttare il machine learning per reperire i risultati pertinenti, aiutando per esempio a trovare le immagini di un preciso luogo o di persone che eseguono una certa azione.

Il metodo ha un duplice vantaggio: rispetto all'impiego degli hashtag (frutto di un inserimento manuale, potenzialmente carente, impreciso o inaffidabile) , richiede un minor intervento umano e inoltre può contare sulle capacità di auto-miglioramento connaturate all'intelligenza artificiale. Le fondamenta tecnologiche di questa impresa si chiamano FbLearner Flow: una piattaforma messa a punto da Facebook per gli ingegneri informatici.

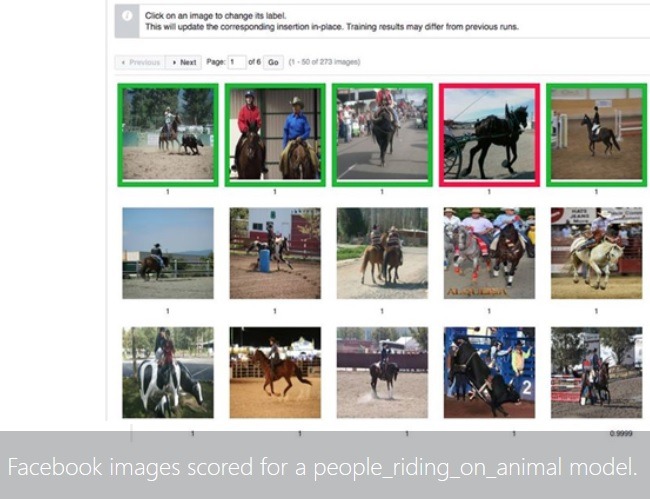

Attualmente l'azienda di Menlo Park la utilizza per condurre 1,2 milioni di test al mese, circa sei volte più del numero di un anno fa, e oltre 200 modelli di apprendimento visuale sono già stati “allenati” e messi alla prova in attività di riconoscimento automatico e assegnazione di descrizioni Att (Automatic Alternative Text). “Fino a ieri”, ha scritto Candela, “i testi ottenuti descrivevano semplicemente l'oggetto delle fotografie. Oggi possiamo annunciare di aver aggiunto a questo un insieme di dodici azioni, e quindi nelle descrizioni si potranno includere elementi come 'persone che camminano', persone che ballano, che vanno a cavallo, che suonano uno strumento, e altro ancora”.

Oltre 130mila fotografie caricate (con l'impostazione di visibilità pubblica) dagli iscritti sul social network sono state adoperate per questi scopi. Un sistema già messo a punto da Facebook riguarda la capacità di individuare specifici oggetti - come una camicia di colore nero, nell'esempio fatto da Candela - all'interno di tutte le immagini pubblicate dagli amici dell'utente oppure tra le immagini consultabili pubblicamente.

Possiamo immaginare di essere appena all'inizio del percorso. Qualche giorno fa, durante la earnings call seguita ai risultati trimestrali, Mark Zuckerberg ha parlato anche di intelligenza artificiale applicata alle immagini e ai video. “Vogliamo che si possa guardare una foto ed essere in grado di capire che cosa rappresenti e se sia potenzialmente interessante per un utente. Similmente, vogliamo che si possa guardare un video a capire se contenga qualcosa di potenzialmente interessante”. Banalmente, il machine learning servirà a filtrare ciò che conta in un mare di contenuti sempre più vasto, prodotto quotidianamente dagli 1,8 miliardi di utenti attivi su Facebook.