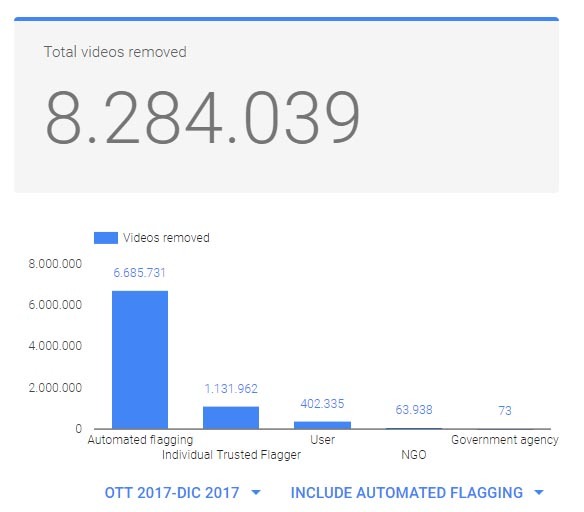

Nell’ultimo trimestre del 2017 Youtube ha rimosso quasi 8,3 milioni di video, in quanto violavano le policy aziendali. Di questi, ben 6,7 milioni sono stati cancellati ricorrendo ad algoritmi “anti abuso” sviluppati internamente, mentre “solo” 1,1 milioni di filmati a causa delle segnalazioni giunte dai membri del programma Trusted Flagger, che include individui, organizzazioni non governative e agenzie di vari Paesi che aiutano Youtube nel processo di individuazione di contenuti che violano le linee guida. A stupire è sicuramente il numero di video rimossi dagli algoritmi di machine learning dell’azienda, integrati a giugno dell’anno scorso nella piattaforma in particolar modo per contrastare il fenomeno della propagazione di contenuti violenti sulla rete. E, cosa ancora più importante per Youtube, per “placare” l’ira degli inserzionisti che vedevano le proprie pubblicità associate a filmati di questo genere.

Affidare una procedura così delicata a un sistema completamente automatico non è affatto consolatorio, in quanto è sempre presente il rischio censura: chi garantisce che i video cancellati dalla piattaforma contengano effettivamente messaggi contrari alle policy della società californiana? Youtube garantisce ovviamente che la propria soluzione stia funzionando bene “sia in canali a basso volume (come l’estremismo violento) sia in aree ad alto volume (spam)”.

E la compagnia è fiera di snocciolare numeri come questi: ad esempio, i sistemi di apprendimento automatico permettono di individuare e rimuovere il 70 per cento dei filmati a sfondo violento entro otto ore dall’upload, per un carico di lavoro che avrebbe richiesto negli ultimi dieci mesi l’impiego di 180mila persone impegnate quaranta ore a settimana. Così facendo, la società di proprietà di Alphabet è riuscita a bannare il 75,9 per cento dei video ancora prima che avessero una sola visualizzazione.

Non che gli esseri umani non siano fondamentali. I “revisori” in carne e ossa rimangono essenziali soprattutto nella fase preliminare di allenamento dei modelli di machine learning. Da giugno 2017, infatti, i team di “fiducia e sicurezza” di Youtube hanno visionato circa due milioni di video alla ricerca di contenuti estremisti, in modo da accelerare la curva di apprendimento dei sistemi esperti dell’azienda. E gli stessi algoritmi verranno applicati anche alla sezione commenti allo scopo di prevenire abusi.

Fonte:Youtube

Google mette in risalto anche i Paesi con più “segnalatori” umani attivi. Le prime dieci posizioni sono occupate da: India, Stati Uniti, Brasile, Russia, Germania, Regno Unito, Messico, Turchia, Indonesia e Arabia Saudita. Nell’ultimo trimestre del 2017 sono stati “flaggati” da persone in carne e ossa oltre 9,3 milioni di filmati unici (un video può essere segnalato più volte e per motivi diversi), ma come già evidenziato solo 1,1 milioni di questi contenuti sono poi stati effettivamente rimossi dalla piattaforma.