“Ora l’Europa detta gli standard a livello mondiale sull’AI”. Così Thierry Breton, commissario al Mercato interno e al Digitale, ha commentato con un tweet l’approvazione dell’AI Act da parte del Parlamento Europeo. Il testo del regolamento è passato a larga maggioranza: 523 voti a favore, 46 contrari e 49 astenuti. Un voto descritto nel tweet “uno a zero” tra democrazia e lobby.

“Stiamo regolamentando il meno possibile, ma il necessario!”, ha aggiunto Breton, difendendo la linea d’azione di un’Unione Europea che spesso viene descritta dai vendor tecnologici come troppo propensa a imporre regole e divieti.

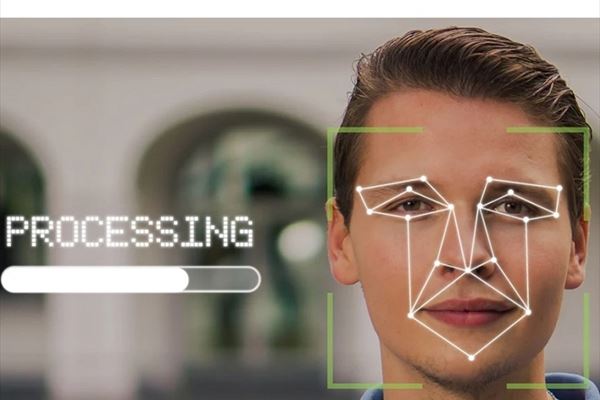

Come già noto, l’AI Act stabilisce una serie di limiti e obblighi per le aziende che sviluppano e commercializzano tecnologie di intelligenza artificiale, ma anche per le istituzioni e aziende che le adottano. Alla base c’è una logica di valutazione del rapporto costi/benefici e del livello rischio delle applicazioni. Per esempio, l’uso di sistemi di riconoscimento biometrico da parte delle forze dell’ordine è concesso solo con “severe misure di tutela”: ci dev’essere l’autorizzazione di un tribunale o di un ente territoriale, che concedano l’identificazione biometrica su un’area geografica ristretta per particolari finalità di sicurezza o di indagine (prevenzione di attacchi terroristici, ricerca di criminali o di persone scomparse).

Sono, invece, vietati del tutto i sistemi di AI che “minacciano i diritti dei cittadini”, come si legge sul sito del Parlamento Europeo. Non sarà consentito, per esempio, applicare software biometrici su immagini registrate da telecamere a circuito chiuso per creare dei database di riconoscimento facciale. Divieto anche per le applicazioni di polizia predittiva, il social scoring, la profilazione sulla base di caratteristiche etniche, la mappatura delle emozioni su immagini registrate nelle scuole o sul posto di lavoro. No anche a qualsiasi forma di AI che “manipoi il comportamento umano o sfrutti le vulnerabilità delle persone”.

Saranno vietati anche i sistemi di riconoscimento delle emozioni sul luogo di lavoro e nelle scuole, i sistemi di credito sociale, le pratiche di polizia predittiva (se basate esclusivamente sulla profilazione o sulla valutazione delle caratteristiche di una persona) e i sistemi che manipolano il comportamento umano o sfruttano le vulnerabilità delle persone.

I sistemi di intelligenza artificiale general-purpose, come i modelli alla base di ChatGpt e altre applicazioni di AI generativa, dovranno soddisfare requisiti di trasparenza. Le aziende sviluppatrici dovranno, per esempio, rispettare le regole europee sul copyright e pubblicare elenchi dettagliati dei contenuti usati per l’allenamento degli algoritmi. I modelli che l’Ue definisce come “i più potenti”, che possono “rappresentare rischi sistemici”, avranno ulteriori obblighi: le aziende dovranno preoccuparsi di valutare in partenza i potenziali rischi e di mitigarli, oltre a dover segnalare eventuali incidenti. Inoltre i deepfake video, audio e di immagini dovranno essere chiaramente etichettati come tali, a scanso di equivoci (o di truffe) ai danni degli utenti.

Big Tech pronte a collaborare

Ora, dopo il voto del Parlamento Europeo, l’AI Act compie un passo in avanti verso il percorso di adozione. Il regolamento è ancora soggetto a verifiche legali e linguistiche ma ci si attende che sarà approvato prima della fine dell’attuale legislatura. Entrerà in vigore 20 giorni dopo la pubblicazione sulla Gazzetta Ufficiale, e dopo due mesi scatterà la possibilità di sanzioni per chi non rispetta le regole. Si rischiano multe dai 7,5 ai 35 milioni di euro (o dall’1,5% al 7% del fatturato globale dell’azienda), a seconda del tipo di violazione.

Amazon ha accolto la notizia del voto del Parlamento Ue con una dichiarazione: “Siamo decisi a collaborare con l’Ue e con l’industria per supportare uno sviluppo sicuro, protetto e responsabile della tecnologia di AI”. Marco Pancini, head of Ue affairs di Meta, ha invece sottolineato che “è critico che non si perda di vista l’enorme potenziale dell’AI di alimentare l’innovazione europea e di permettere la concorrenza, e l’apertura è cruciale”.

Le promesse del governo: un miliardo di euro per l'AI in Italia

Intanto, in Italia la premier Giorgia Meloni ha promesso che attraverso Cassa Depositi e Prestiti nel nostro Paese verrà investito un miliardo di euro sull’intelligenza artificiale.Cdp Venture Capital mobiliterà fondi di investimento già attivi che coinvolgono aziende di AI e al contempo verrà creato un nuovo fondo specializzato sull’intelligenza artificiale.

L’annuncio è arrivato tramite videomessaggio in un convegno organizzato a Roma dal Dipartimento per la trasformazione digitale e dall’Agenzia per l’Italia Digitale. Meloni ha anche annunciato che il governo sta lavorando a un provvedimento legge “che ha come obiettivo quello di stabilire alcuni principi, determinare le regole complementari a quelle del regolamento europeo che è in via di approvazione e individuare le misure più efficaci per stimolare il nostro tessuto produttivo”. Il governo sta anche lavorando “per individuare l’organismo più idoneo a svolgere le funzioni di Autorità competente sull’uso delle tecnologie basate sull’intelligenza artificiale”.