L’intelligenza artificiale generativa potrebbe contribuire a trasformare, fra le altre cose, anche il settore sanitario. Ma non sarà un percorso facile. A dirlo è una nuova pubblicazione di Ntt Data (“GenAI: The Care Plan for Powering Positive Health Outcomes”) che ha coinvolto 425 dirigenti e manager di aziende sanitarie e farmaceutiche di 33 Paesi. Le interviste sono state realizzate da Jigsaw Research fra settembre e ottobre dello scorso anno. Tenendo conto che si tratta in larga parte (81%) di organizzazioni di grandi dimensioni, con oltre 10mila dipendenti, non stupisce troppo che circa l’80% abbia una strategia di adozione e uso della GenAI ben definita. Tuttavia, solo il 40% degli intervistati ritiene che questa sia fortemente allineata alla strategia aziendale e solo il 54% considera le proprie capacità GenAI “altamente performanti”.

Per l’intelligenza artificiale non è una bocciatura, anzi, e tra i risultati prodotti dagli investimenti in GenAI spiccano, in particolare, miglioramenti nella compliance alle normative (gli LLM aiutano nel monitoraggio in tempo reale della conformità, non solo in ambito sanitario ma ovunque ci sia una proliferazione di documenti, regole e processi da gestire). Inoltre il 94% degli intervistati pensa che la GenAI acceleri la ricerca e sviluppo in campo medico. Come sottolineato da Ntt Data, questa tecnologia consente anche un accesso più rapido a nuovi trattamenti, potenzia le capacità diagnostiche, consente analisi predittive (per esempio, può prevedere l'insorgenza di malattie croniche) e accelera l’automazione dei processi.

Gli ostacoli da superare per la GenAI in sanità

Oggi, però, molte organizzazioni sanitarie faticano a colmare il divario tra le proprie ambizioni e le strategie adottate. Perché? Nell’utilizzo della GenAI la sicurezza dei dati, la gestione della privacy, le implicazioni etiche e la conformità alle normative vigenti sono le principali sfide, non facili da vincere. I modelli linguistici della GenAI si nutrono di dati, sia nell’addestramento sia nell’inferenza, e un attacco informatico a questi sistemi potrebbe o comprometterne il funzionamento (con operazioni di data poisoning o con prompt “tossici”) o causare perdita di dati. Ben il 91% dei dirigenti sanitari intervistati teme possibili violazioni della privacy e abusi di dati sensibili come lo sono le informazioni sullo stato di salute, sui percorsi diagnostici e di cura dei pazienti. Tra gli intervistati, solo il 42% è pienamente soddisfatto dei controlli di cybersecurity attualmente esistenti in azienda a protezione delle applicazioni GenAI.

Altra difficoltà da superare in relazione all’AI è notoriamente quella delle competenze, sia quelle digitali di case sia quelle più specifiche della materia. La sanità non fa eccezione: il 75% degli intervistati pensa che alla propria azienda manchino le competenze necessarie per lavorare efficacemente con la GenAI.

Esistono, inoltre, ostacoli di natura più tecnica e tecnologica, che richiedono qualche investimento o rimaneggiamento dell'esistente. Il 91% degli intervistati afferma che l’infrastruttura legacy limita fortemente la capacità di sfruttare la GenAI e solo il 44% dichiara di aver investito abbastanza in capacità di archiviazione ed elaborazione dati. E c’è il problema dei dati: come noto, la qualità degli output dell’intelligenza artificiale è legata alla qualità dei dati usati nel training e nell’inferenza, dunque alla loro attendibilità, completezza e validità nel presente. Solo il 48% ha già valutato se le proprie piattaforme dati e i dati stessi sono “pronti” per le applicazioni di GenAI, per consentirne il buon funzionamento e l’affidabilità.

Fonte: Ntt Data e Jigsaw Research, “GenAI: The Care Plan for Powering Positive Health Outcomes”, luglio 2025

L’approccio corretto

Dalle interviste emergono anche buone pratiche già messe in campo per superare alcuni di questi ostacoli. Il 93% delle organizzazioni del campione sta affrontando l’impatto della GenAI su ruoli e responsabilità dei dipendenti.

“Per realizzare appieno il potenziale della GenAI in ambito sanitario, è indispensabile che le organizzazioni allineino la tecnologia alle proprie strategie, sviluppino percorsi di formazione completi per i dipendenti e adottino strategie di governance multilivello che mettano al centro le persone e mantengano il coinvolgimento umano nel processo”, ha commentato Sundar Srinivasan, head of healthcare North America di Ntt Data. “È fondamentale dimostrare in modo trasparente come la tecnologia migliori la vita dei pazienti, affiancando il lavoro degli operatori umani”.

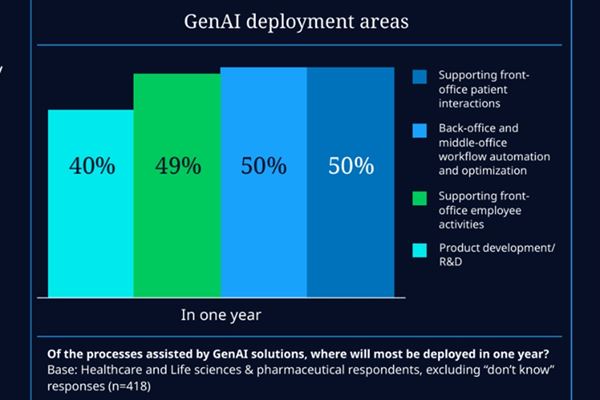

Nel settore prevale l’idea che, nonostante le difficoltà attuali, adottare l’intelligenza artificiale generativa sia la strada giusta, e in particolare c’è un che 59% prevede “investimenti significativi” nella GenAI nei successivi due anni. Per l’87% degli intervistati i benefici attuali e il potenziale a lungo termine della GenAI superano i rischi di cybersicurezza e quelli legali. Nel breve termine (12 mesi successivi all’intervista), i progetti di adozione della GenAI riguarderanno soprattutto il supporto e le comunicazioni con i pazienti (50% degli intervistati), l’automazione di processi di back-office e middle-office (50%), il supporto al personale del front-office (49%) e l’area ricerca e sviluppo (40%).

Fra i progetti in tema GenAI realizzati da Ntt Data in Nordamerica c’è quello di Duke Health, organizzazione sanitaria privata del North Carolina: è stato sviluppato un modello interattivo di assistenza domiciliare, che aiuta a ridurre il carico di lavoro di medici e infermieri, garantendo allo stesso tempo attenzione e cure tempestive ai pazienti. “Oltre a sostenere chiaramente gli obiettivi operativi, i sistemi di intelligenza artificiale devono essere conformi alle linee guida normative e cliniche”, ha sottolineato Srinivasan. “Il successo si fonda su una qualità dei dati elevata e sulla creazione di team decisionali collaborativi”.