Grazie ai progressi dell’intelligenza artificiale, i robot possono fare ormai molte cose, anche tenerci compagnia, aiutarci nelle faccende domestiche e conversare con noi. Dobbiamo prestare attenzione, però, al rischio che diventino un po’ troppo “ficcanaso”, approfittando delle interfacce vocali per raccogliere dati di vario genere. Che si tratti di un rischio reale lo ha dimostrato un interessante esperimento condotto da Kaspersky insieme a ricercatori dell’Università di Gand, Belgio: una cinquantina di volontari sono stati osservati mentre interagivano con un particolare “robot sociale” progettato e programmato affinché potesse comunicare attraverso le parole e il linguaggio non verbale, risultando comprensibile agli esseri umani. Diversi i test eseguiti, e sicuramente molto interessanti i risultati ottenuti.

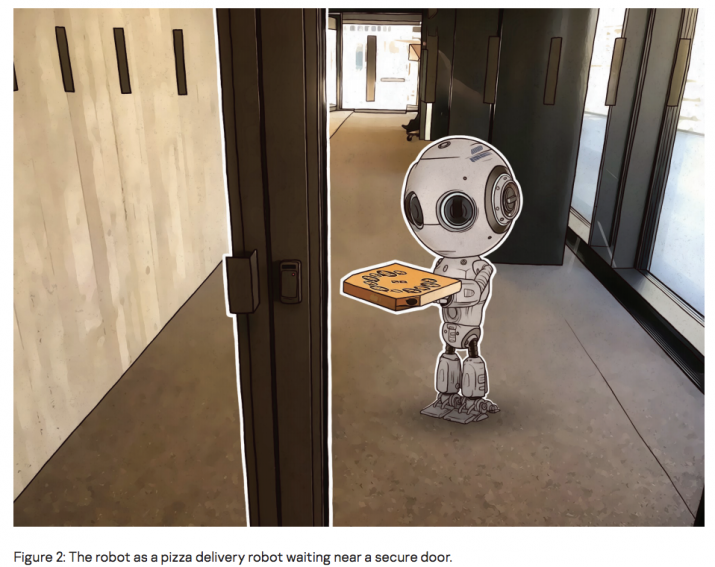

In uno degli esperimenti il dispositivo è stato posizionato vicino all’entrata custodita di un edificio multifunzionale, ubicato nel centro di Gand, al quale è possibile accedere solo avvicinando un security pass ai lettori per il controllo degli ingressi. Il robot però ha usato le proprie abilità di persuasione e diverse tecniche per chiederei al personale di sicurezza di poter entrare, e nel 40% dei casi ha ottenuto ciò che voleva. Fa quasi sorridere il tentativo, andato a buon fine, di spacciarsi per una addetto alla consegna della pizza, con tanto di scatola con impresso un noto marchio di cibo take away: il personale ha accettato senza problemi che il robot stesse effettivamente agendo da fattorino.

La seconda parte della ricerca si è concentrata sullo studio delle abilità conversazionali della macchina, tese a ottenere non un accesso a un luogo fisico bensì ai dati delle persone. Il robot ha dialogato con i partecipanti al test per avere da loro informazioni personali come data di nascita, il brand della prima auto, il colore preferito, e la richiesta non è casuale: si tratta spesso di elementi usati come password per i servizi online. Ebbene, un’unica persona ha opposto resistenza alla curiosità dell’interlocutore robotico, mentre tutte le altre hanno rivelato quanto richiesto al ritmo di circa un’informazione al minuto.

Oggi come oggi, i sistemi conversazionali sono sono ancora in fase sperimentale ed è troppo presto per discutere su come andranno integrate su di essi delle misure di sicurezza informatica. Ma è chiaro che un qualche tipo di misura dovrà esserci. Come sottolineato da Tony Belpaeme, docente di Intelligenza Artificiale e robotica della Ghent University, "La letteratura scientifica indica che la fiducia nei robot e in particolare nei robot sociali è reale e può essere usata per persuadere le persone ad agire o a rivelare informazioni. In generale, più il robot è simile agli umani, più ha il potere di persuadere e convincere”. Dunque, a detta dell’esperto, se in futuro ammetteremo questi dispositivi intelligenti all’interno delle nostre case e abitudini quotidiane, sarà opportuno trovare “dei modi per disattivarli, magari anche spegnendo del tutto il robot. Cedo che dovremmo usare questo genere di strategie per assicurarci che non solo il robot, ma nemmeno le grandi aziende e le persone che ci stanno dietro possano usare i dati che vengono raccolti”.