È come mettere “in scatola” un intero data center, o più precisamente la potenza di calcolo e le risorse di memoria di 250 server: questo il conteggio fatto dal Ceo di Nvidia, Jen-Hsun Huang, presentando il nuovo sistema Dgx-1. Un supercomputer “in-a-box”, il primo del suo genere, ovvero un sistema che integra software di deep learning e potente hardware nel formato di un singolo server. Presentato duranta la Gpu Technology Conference (Gtc) in corso a San Jose, Dgx-1 utilizza otto Tesla P100, ovvero l’ultimo modello di processore grafico di Nvidia, lanciato nella medesima occasione.

Si tratta del top di gamma della nuova architettura Pascal, già in produzione e atteso su prossimi modelli di server che arriveranno in commercio nel primo trimestre del 2017. Nvidia, inoltre, già entro la fine di quest’anno renderà disponibili attraverso il cloud alcune soluzioni basate su Tesla P100, utilizzabili per attività di deep learning da remoto.

A questi stessi scopi serve anche il Dgx-1, con la differenza che il sistema racchiude una potenza di calcolo mastodontica, giustificazione del suo esorbitante costo di 129mila dollari. Per eseguire attività che simulano in funzionamento del cervello umano, analizzando e correlando grandi quantità di dati, il Dgx-1 può sfruttare i 16 GB di Ram di ciascuna delle otto Gpu Tesla P100 e una disponibilità di storage su Ssd di 7 TB. Tutto questo corrisponde a un incremento di 12 dodici volte rispetto alle soluzioni presentate da Nvidia nella scorsa edizione del Gtc, le quali integravano quattro Gpu basate su architettura Maxwell.

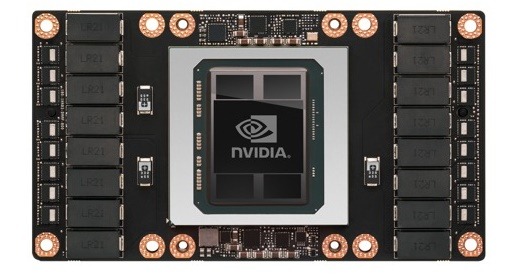

Nvidia Tesla P100

Un tale balzo in avanti sottolinea non solo i progressi della tecnologia, ma l’interesse dei vendor per il mondo dell’apprendimento automatico e delle applicazioni. Risale a un paio di settimane fa il lancio, da parte di Google, di Cloud Machine Learning, una piattaforma per la creazione di applicazioni di apprendimento automatico, mentre è un continuo work in progress il potenziamento dell’intelligenza automatica interna ai servizi di Big G (a partire dal motore di ricerca per l’indicizzazione di testi e immagini, fino a Google Transalte, a Google Now e a Inbox). Facebook, invece, a fine 2015 ha scelto di rendere open source il sistema hardware di intelligenza artificiale utilizzato dal social network per gestire i suoi contenuti e per personalizzare i news feed.