L’intelligenza artificiale può essere etica, sicura responsabile e sostenibile? E come? Si è parlato molto negli ultimi anni di AI etica (anche se più corretto sarebbe discutere di utilizzi etici dell’AI, ma ci siamo capiti) e tuttavia per garantirci un futuro libero da discriminazioni, abusi e conseguenze imprevedibili è necessario ragionare anche sulla sicurezza (cyber e materiale), e sulla sostenibilità, non solo ecologica, dell’intelligenza artificiale. E sono necessarie, ahimè, anche le regole e le punizioni per chi non le rispetta.

Un nuovo studio di Federprivacy, condotto su mille professionisti italiani esperti di protezione dei dati personali (803 rispondenti), porta avanti il concetto che non basti l’etica per governare l’AI. Il tema va inserito nella più ampia questione della privacy e legato, quindi, al Gdpr. I Large Language Model vivono, chiaramente, di dati, ma le modalità del loro trattamento e le accuratezze adoperate per distinguere i dati personali dagli altri fanno la differenza.

Il 63% dei rispondenti pensa sia importante promuovere un uso etico dell'intelligenza artificiale, ma un ancor più cospicuo 73% pensa sia anche necessario un maggiore rispetto delle normative. L’opinione di gran lunga prevalente, 73,9%, è che le attuali regole sulla privacy e le sanzioni previste siano sufficienti, ma che serva un’azione più efficace per farle rispettare.

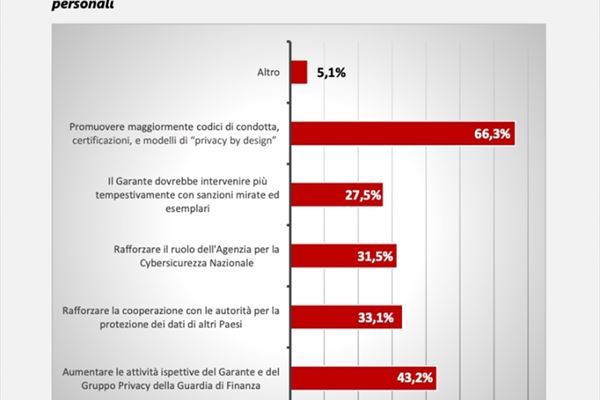

Alla domanda su che cosa si potrebbe fare per aumentare la compliance ai regolamenti come il Gdpr, il 66,3% degli addetti ai lavori suggerisce di puntare su codici di condotta, certificazioni, e modelli di privacy by design, mentre il 43,2% propone di aumentare le ispezioni del Garante e della Guardia di Finanza. Altre strategie possibili sono il rafforzamento della cooperazione con le autorità di altri Paesi (caldeggiato dal 33,1%) e del ruolo dell’Acn, l’agenzia nazionale di cybersicurezza (31,5%), oppure interventi più tempestivi del Garante con sanzioni mirate ed esemplari (27,5%).

Fonte: Osservatorio Federprivacy, “Innovazione responsabile & compliance per la sostenibilità della trasformazione digitale”, giugno 2025

Per una intelligenza artificiale sostenibile anche dal punto di vista della protezione dei dati, gli intervistati propongono di “mettere l’uomo al centro” (70,1%), di promuovere l’educazione digitale (66,6%) e l’utilizzo etico dell’AI (63%), di preoccuparsi di garantire l’inclusione (30,1%) e anche di rafforzare l’organico del Garante della Privacy (18,7%).

"Si parla tanto di etica per affrontare le sfide dell'intelligenza artificiale, ma attualmente essa costituisce un principio troppo astratto per offrire una guida concreta per lo sviluppo della società digitale”, ha commentato

Nicola Bernardi, presidente di Federprivacy. “

È quindi comprensibile che la comunità di addetti ai lavori invochi punti riferimento più concreti come il rispetto delle regole. E i risultati del sondaggio mostrano obiettività e coerenza, perché non chiedono una società digitale basata esclusivamente sulla privacy solo perché una manciata di Big Tech non la rispetta come dovrebbe, ma ben il 78,3% indica la necessità di trovare un equilibrio per conciliare i diritti fondamentali con l'innovazione, e questo non dovrebbe andare a discapito delle piccole realtà imprenditoriali”.