Il quantum computing continua a muoversi lungo quella sottile linea che separa la promessa tecnologica dalla reale applicazione industriale. Questa volta, però, il salto appare molto più concreto del solito. IBM, Cleveland Clinic e RIKEN hanno annunciato di aver simulato con successo complessi proteici fino a 12.635 atomi, il più grande sistema molecolare mai elaborato utilizzando computer quantistici.

Il risultato non rappresenta soltanto un nuovo record tecnico. Per la prima volta, infatti, il quantum computing dimostra di poter affrontare un problema biologicamente rilevante di dimensioni tali da avvicinarsi a scenari concreti di ricerca farmaceutica e life science.

L’aspetto più interessante è che il progresso è stato rapidissimo: secondo i ricercatori, le proteine simulate sono circa 40 volte più grandi rispetto a quelle che il medesimo approccio riusciva a gestire soltanto sei mesi fa. Nello stesso periodo, l’accuratezza di una fase critica della simulazione è migliorata fino a 210 volte.

Il vero obiettivo: accelerare la scoperta di nuovi farmaci

Dietro l’esperimento esiste una motivazione industriale molto precisa. Una delle grandi difficoltà della ricerca farmaceutica moderna consiste infatti nel prevedere accuratamente il modo in cui una molecola candidata possa legarsi a una proteina target. Si tratta di un problema computazionale estremamente complesso, perché la quantità di variabili cresce rapidamente all’aumentare delle dimensioni molecolari. I sistemi classici di simulazione, pur essendo potentissimi, iniziano a mostrare limiti importanti quando si tratta di modelli biologici molto grandi e dinamici.

È qui che il quantum computing potrebbe rivoluzionare la ricerca. Riuscire a simulare con maggiore accuratezza le interazioni molecolari nelle prime fasi degli studi significherebbe ridurre tempi e costi di sviluppo dei farmaci, oggi spesso superiori ai dieci anni per singolo medicinale. Secondo Kenneth Merz, autore principale dello studio e ricercatore del dipartimento Computational Life Sciences della Cleveland Clinic, il superamento della soglia dei 12.000 atomi amplia in modo significativo la scala delle simulazioni biologicamente rilevanti ottenibili con sistemi quantistici. Anche Jay Gambetta, direttore di IBM Research, ha sottolineato il cambio di fase del settore: per anni il quantum computing è stato una promessa teorica, mentre oggi inizia a produrre risultati concretamente utili alla ricerca scientifica.

Quantum-centric supercomputing: il modello ibrido che cambia tutto

Uno degli aspetti più importanti del progetto riguarda l’architettura tecnica utilizzata. Il risultato non è stato ottenuto usando esclusivamente computer quantistici, ma grazie a un approccio ibrido definito da IBM “quantum-centric supercomputing”.

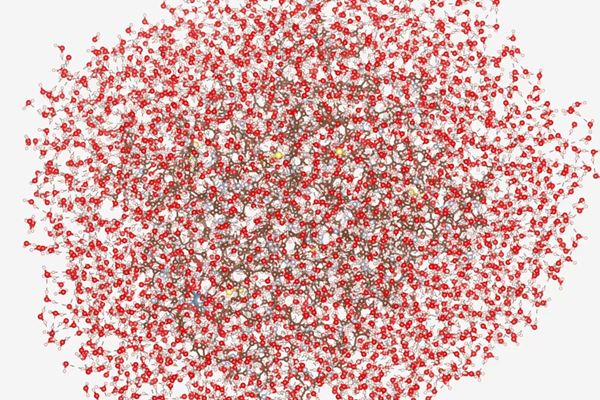

In pratica, computer quantistici e supercomputer classici collaborano, sfruttando i rispettivi punti di forza. I sistemi tradizionali si occupano della scomposizione iniziale del problema, mentre i processori quantistici affrontano il comportamento dal punto di vista quantomeccanico. Nel progetto sono stati utilizzati i processori IBM Quantum Heron da 156 qubit, installati sia presso la Cleveland Clinic negli Stati Uniti sia nei laboratori RIKEN in Giappone. Sul fronte HPC classico, invece, sono entrati in gioco due dei supercomputer più potenti al mondo: Fugaku e Miyabi-G. Durante alcune fasi della simulazione sono stati necessari fino a 94 qubit e quasi 6.000 operazioni quantistiche.

L’algoritmo EWF-TrimSQD e il salto di scala

Gran parte del progresso deriva però dal software più che dall’hardware. I ricercatori hanno infatti sviluppato un nuovo algoritmo ibrido quantistico-classico chiamato EWF-TrimSQD, progettato per ridurre drasticamente l’overhead computazionale. In termini pratici, l’algoritmo permette di rappresentare la chimica molecolare in modo più efficiente direttamente sull’hardware quantistico, rendendo possibile affrontare sistemi che fino a poco tempo fa erano considerati irraggiungibili.

Questo è uno degli elementi più interessanti dell’intera vicenda: anche nel quantum computing, i progressi non dipendono soltanto dall’aumento dei qubit disponibili, ma gioca un ruolo decisivo la capacità di costruire algoritmi in grado di sfruttare meglio le risorse esistenti. Il risultato è che il limite delle simulazioni molecolari realistiche si sta spostando molto più rapidamente del previsto. Questo esperimento suggerisce che forse sarebbe più appropriato iniziare a valutare il potenziale dei computer quantistici ma in base alla dimensione e alla rilevanza dei problemi reali che riescono ad affrontare piuttosto che tramite il numero di Qubit che riescono a impiegare.

È una differenza enorme, soprattutto per il mercato enterprise. Significa che il quantum computing sta lentamente passando dalla fase “laboratorio” alla fase “strumento operativo”, entrando nel radar di aziende farmaceutiche, centri di ricerca, governi e grandi player industriali. E anche se la strada verso applicazioni commerciali di massa resta ancora lunga, il salto registrato negli ultimi sei mesi dimostra quanto velocemente il settore stia evolvendo.